相机标定 matlab opencv ROS三种方法标定步骤(3)

三 , ROS 环境下 如何进行相机标定

刚开始做到的时候遇到一些问题没有记录下来,现在回头写的时候都是没有错误的结果了,首先使用ROS标定相机,

要知道如何查看节点之间的流程图 rosrun rqt_graph rqt_graph ,如何查看我们运行的节点 rosnode list, 查看运行的话题 rostopic list 或者rostopic list -v 查看每个节点的性质

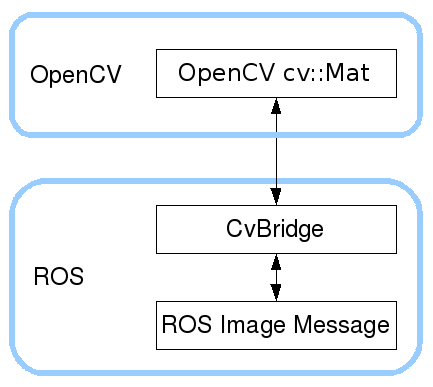

首先需要学习的是 wiki.ros.org/cv_bridge/Tutorials/UsingCvBridgeToConvertBetweenROSImagesAndOpenCVImages

了解cv_bridge 这个程序包是连接ROS和Opencv的程序包,就好像是一个桥梁的作用一样,关系图:

紧接着可以学习 wiki.ros.org/image_common?distro=indigo 这个就是就是教你如何去订阅和发布图像或者视频的话题等问题

那么其中功能最多的就是 wiki.ros.org/image_pipeline?distro=indigo 这个程序包里面就有我们想要的相机标定的程序以及方法

同时最重要的是 要驱动摄像头安装包就在于 wiki.ros.org/image_pipeline?distro=indigo 这里我用的是USB 的就可以对应下载该程序包然后

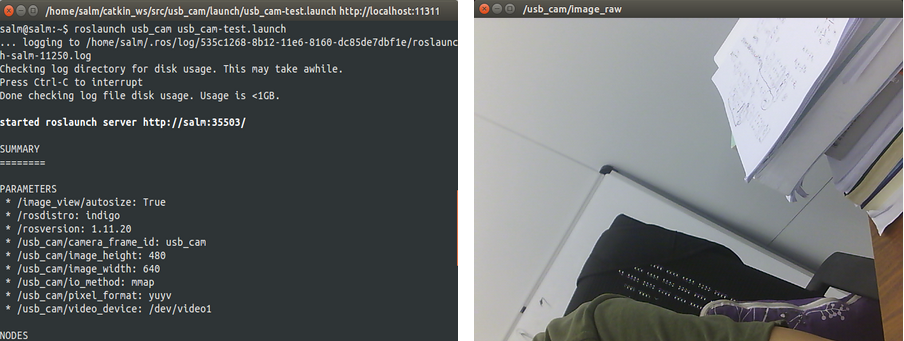

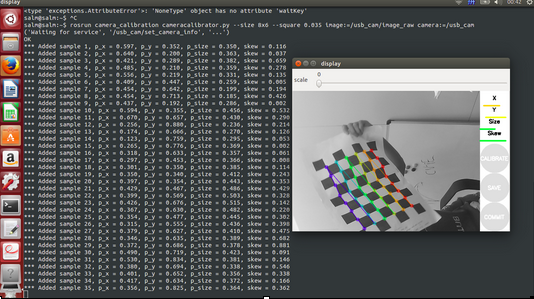

catkin_make一下就可以驱动摄像头,可以看到原始图像,运行看到的结果:

顺利的启动摄像头就可以学习如何去标定相机了

因为就是用别人的代码也没什么改动,所以直接下载所提及的程序包,然后catkin_make

一般都不会有什么错误出现,命令窗口执行

$ roscore

$ roslaunch usb_cam usb_cam-test.launch (可以在.launch文件里修改要用的摄像头,比如笔记本的摄像头是/dev/video0,外接USB摄像头是/dev/video1)

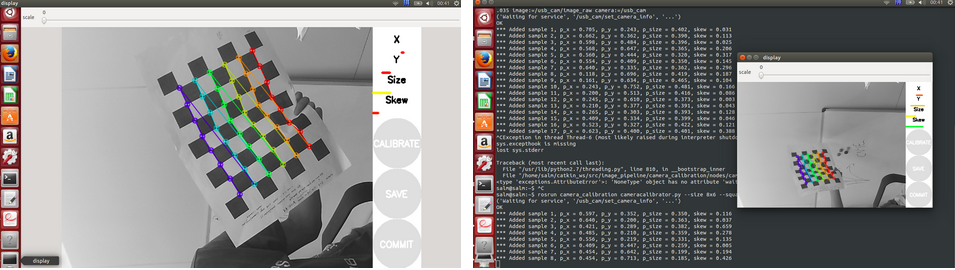

$ rosrun camera_calibration cameracalibrator.py --size 8x6 --square 0.035 image:=/usb_cam/image_raw camera:=/usb_cam

(这里的标定模板我是用A3纸张打印出来,为8*6 35mm的标定棋盘)

所以 参数要改为与实际标定模板一致的数据 --size 8x6 --square 0.035

image:=/usb_cam/image_raw camera:=/usb_cam 就是要对应USB 摄像头的原始的节点和话题(我就刚开始没有对上号)

(完全按照网上的步骤来是不会出现想要的结果的)

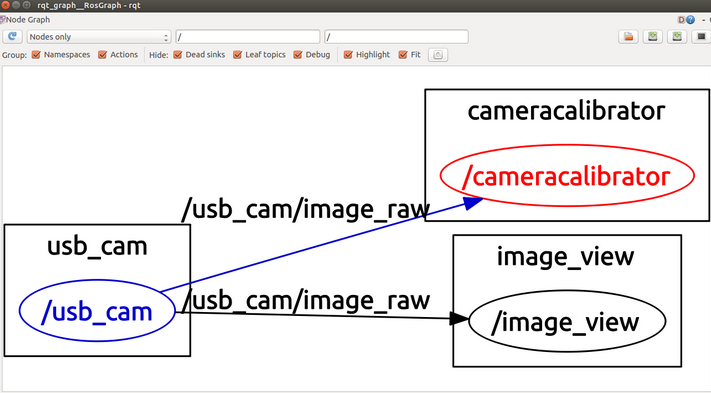

我们可以使用 rosrun rqt_graph rqt_graph 来查看是否calibraton节点是否已经订阅成功如图:(倘若cameracalibrator与usb_cam没有订阅成功,就需要使用

rostopic list -v 查看话题)

运行的结果 如图

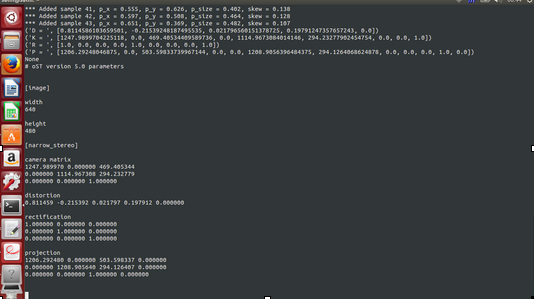

直到采集了50个采样点 左边的CALIBRATE变为绿色 就可以点击开始标定,结束后会将标定结果打印到命令窗口:

后续还有很多内容可以写上去,暂时就到这里

(大神请忽略,谢谢)

更多相关:

-

点云PCL免费知识星球,点云论文速读。文章:Single-Shot is Enough: Panoramic Infrastructure Based Calibration of Multiple Cameras and 3D LiDARs作者:Chuan Fang1 , Shuai Ding, Zilong Dong, Hong...

-

本文提出一种新颖的方法,可以对3D lidar和带有标定板的相机进行全自动的外参标定,提出的方法能够从lidar的每一帧点云数据中利用强度信息提取标定板的角点。通过激光的反射强度和棋盘格颜色之间的相关性的约束来优化将棋盘格分割的模型,所以一旦我们知道了3D 点云中棋盘的角点,那么两个传感器之间的外部校准就转换成了3D-2D的匹配问题。...

-

一 、 理解摄像机模型,网上有很多讲解的十分详细,在这里我只是记录我的整合出来的资料和我的部分理解 计算机视觉领域中常见的三个坐标系:图像坐标系,相机坐标系,世界坐标系,实际上就是要用矩阵来表 示各个坐标系下的转换,首先在图像坐标系下与相机坐标系的关系 &nbs...